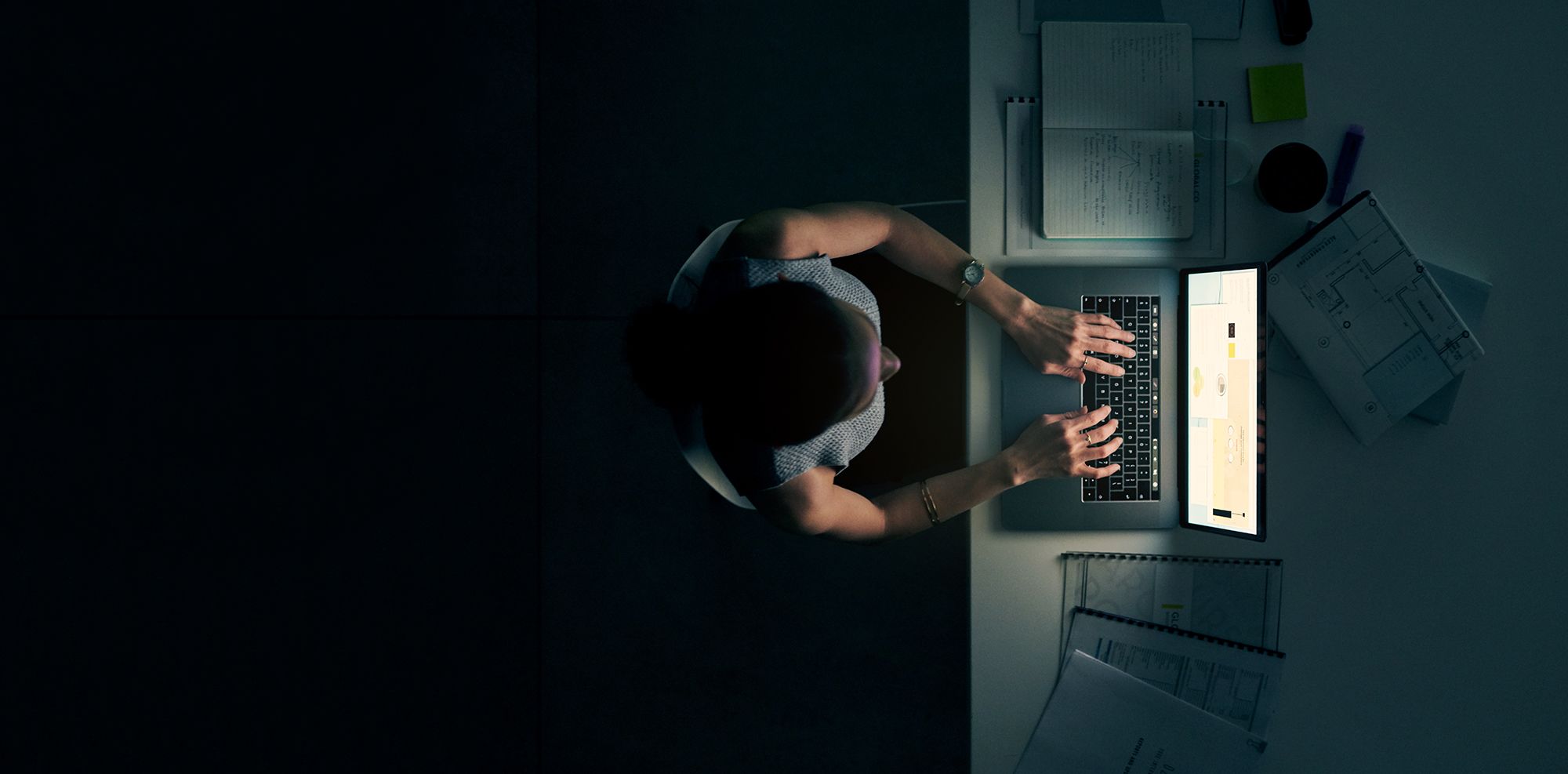

5月30日(周二),数十位人工智能行业领袖、学者,甚至一些名人呼吁降低人工智能导致全球灭绝的风险,他们在一份简短声明中表示,人工智能灭绝事件的威胁应该成为全球的首要任务。人工智能安全中心发表的声明称:“减轻人工智能带来的灭绝风险,应该与流行病和核战争等其他社会规模的风险一起,成为全球的优先事项。”

该声明由OpenAI首席执行官萨姆·奥特曼(Sam Altman);被称为人工智能“教父”杰弗里·辛顿(Geoffrey Hinton);谷歌DeepMind和Anthropic的高管和研究人员;微软首席技术官凯文·斯科特(Kevin Scott);互联网安全和密码学先驱布鲁斯·施奈尔(Bruce Schneier);气候倡导者比尔·麦基本(Bill McKibben);还有音乐家格兰姆斯(Grimes)等主要行业官员签署。

该声明强调了人们对不受控制的人工智能的最终危险的广泛担忧。人工智能专家表示,社会距离发展出科幻小说里的那种通用人工智能还有很长的路要走,今天的尖端聊天机器人主要是根据训练数据复制模式,而不是自己思考。尽管如此,对人工智能行业的大量炒作和投资导致人们呼吁在人工智能时代之初,即在任何重大事故发生之前进行监管。

该声明发表之前,OpenAI的ChatGPT取得了病毒式的成功,这有助于加剧科技行业在人工智能方面的军备竞赛。作为回应,越来越多的议员、倡导团体和科技业内人士对新一批人工智能聊天机器人传播错误信息和取代工作岗位的可能性发出了警告。辛顿的开创性工作帮助塑造了今天的人工智能系统,他此前告诉美国有线电视新闻网,在突然意识到这些东西变得比我们更聪明之后,他决定离开谷歌,揭发这项技术。

人工智能安全中心主任丹·亨德里克斯(Dan Hendricks)5月30日(周二)在Twitter上表示,由剑桥大学人工智能教授大卫·克鲁格(David Kreuger)首先提出的声明,并不排除社会解决其他类型的人工智能风险,如算法偏见或错误信息。亨德里克斯将5月30日(周二)的声明与原子科学家“对他们创造的技术发出警告”的警告进行了比较。“社会可以同时管理多种风险,这不是‘非此即彼’,而是‘是/并且’,”亨德里克斯发推文说,“从风险管理的角度来看,仅仅优先考虑当前的危害是鲁莽的,同样忽视它们也是鲁莽的。”

未经允许不得转载:城市新闻网icitynews » 警告“灭绝”风险!人工智能行业和研究人员签署相关声明